La apertura se integra en la sociedad de las máquinas: OpenMind reúne la mente y el orden

Más allá de los agentes de IA, los robots físicamente encarnados constituyen otro relevante escenario vertical en el auge de la inteligencia artificial. Según un informe de Morgan Stanley, se estima que el mercado mundial de robots humanoides podría superar los 5 billones de dólares para 2050.

El desarrollo de la IA está transformando progresivamente los robots; de simples brazos mecánicos en fábricas han pasado a integrarse como asistentes en la vida cotidiana, dotados de percepción y comprensión gracias a la inteligencia artificial e incluso capaces de tomar decisiones autónomas. El principal desafío reside en la ausencia de protocolos de comunicación universal: cada fabricante emplea códigos y lógicas propios, lo que da lugar a software incompatible e inteligencias no compartidas. Es comparable a tener un coche de una marca y un Tesla, pero que no pueden siquiera evaluar conjuntamente el estado de la carretera, mucho menos realizar tareas colaborativas.

OpenMind se propone revertir este entorno fragmentado. No fabrican robots: están desarrollando una infraestructura colaborativa donde los robots utilizan el mismo lenguaje, comparten reglas y completan tareas conjuntamente. Haciendo una analogía, iOS y Android permitieron la explosión de apps en móviles, Ethereum la fundación común del universo cripto, y OpenMind aspira a crear un “sistema operativo” y una “red colaborativa global” para robots.

En síntesis, OpenMind está construyendo un sistema operativo universal para robots, que les permita no solo percibir y actuar, sino también colaborar de forma segura y a gran escala en cualquier contexto mediante coordinación descentralizada.

Quiénes Respaldan Esta Plataforma Abierta

OpenMind ha cerrado una financiación de 20 millones de dólares en rondas semilla y Serie A, liderada por Pantera Capital. Más aún, la “amplitud y complementariedad” de los inversores ha reunido prácticamente todos los componentes fundamentales del sector: por un lado, actores de largo plazo del ecosistema tecnológico y financiero occidental — Ribbit, Coinbase Ventures, DCG, Lightspeed Faction, Anagram, Pi Network Ventures, Topology, Primitive Ventures— expertos en paradigmas cambiantes de cripto y de infraestructura IA, capaces de aportar conocimientos en modelos, redes y cumplimiento normativo para la “economía de agentes + internet de las máquinas”; por otro, el impulso industrial oriental, representado por la cadena de suministro y la manufactura de Sequoia China, que comprende los requisitos técnicos y de coste “para que un prototipo alcance la producción escalable”. Esta alianza provee a OpenMind no solo de capital, sino también de la ruta y los recursos “del laboratorio a la fábrica, del software a la manufactura basal”.

Este recorrido empieza a converger con los mercados financieros tradicionales. En junio de 2025, KraneShares lanzó el ETF Global Humanoid and Embodied Intelligence Index (KOID) y eligió a Iris, robot humanoide desarrollado por OpenMind y RoboStore, para inaugurar la campana de apertura del NASDAQ, convirtiéndose en el primer “invitado robot” en protagonizar este acto en la historia del mercado. Es tanto una sincronización entre la narrativa tecnológica y financiera como una señal pública sobre “cómo se valorarán y liquidarán los activos máquina”.

Como afirma Nihal Maunder, socio de Pantera Capital:

“Si queremos que las máquinas inteligentes operen en entornos abiertos, necesitamos una red de inteligencia abierta. Lo que OpenMind está haciendo para los robots equivale a lo que Linux hizo en el software y Ethereum en la blockchain.”

De la Investigación a la Fabricación

Jan Liphardt, fundador de OpenMind, es profesor asociado en Stanford y exprofesor en Berkeley, con una sólida carrera investigadora en datos y sistemas distribuidos, vinculada tanto a la academia como a la ingeniería. Defiende la reutilización open source, la sustitución de sistemas propietarios por mecanismos auditables y rastreables, y el enfoque interdisciplinar que integra IA, robótica y criptografía.

El equipo central de OpenMind procede de instituciones como OKX Ventures, Oxford Robotics Institute, Palantir, Databricks y Perplexity, cubriendo áreas clave como control robótico, percepción y navegación, orquestación multimodal y LLM, sistemas distribuidos y protocolos on-chain. Además, su consejo asesor, conformado por referentes académicos y del sector (Steve Cousins de Stanford, Bill Roscoe del Oxford Blockchain Center y Alessio Lomuscio, experto en IA y seguridad en Imperial College), garantiza que los robots sean “seguros, conformes y fiables”.

La Solución de OpenMind: Arquitectura de Dos Niveles, Un Sistema de Orden

OpenMind ha desarrollado una infraestructura reutilizable que permite a los robots colaborar y comunicarse entre dispositivos, fabricantes y fronteras:

Parte del dispositivo: proporciona un sistema operativo nativo de IA, OM1, para robots físicos, conectando todo el ciclo desde la percepción hasta la ejecución, habilitando que máquinas de distinta naturaleza comprendan su entorno y completen tareas;

Parte de red: crea una red colaborativa descentralizada, FABRIC, que gestiona identidad, asignación de tareas y comunicación, garantizando que los robots puedan reconocerse, distribuirse tareas y actualizar su estado colaborativamente.

Esta combinación de “sistema operativo + capa de red” habilita que los robots actúen individualmente y colaboren, alineen procesos y ejecuten tareas complejas de manera conjunta en una red colaborativa universal.

OM1: Sistema Operativo Nativo IA para el Entorno Físico

Así como los teléfonos inteligentes requieren iOS o Android para ejecutar aplicaciones, los robots precisan un sistema operativo para modelos de IA, procesamiento de señales, toma de decisiones lógicas y ejecución física.

OM1 es ese sistema operativo nativo IA para robots reales: les permite percibir, comprender, planificar y ejecutar tareas en entornos diversos. A diferencia de los sistemas cerrados de control tradicional, OM1 es open source, modular y agnóstico respecto al hardware, funcionando tanto en humanoides como en cuadrúpedos, rodantes o brazos robóticos.

Cuatro Componentes Clave: De la Percepción a la Ejecución

OM1 segmenta la inteligencia robótica en cuatro fases universales: Percepción → Memoria → Planificación → Acción. Este proceso, 100% modularizado por OM1 y articulado mediante un lenguaje de datos unificado, posibilita capacidades inteligentes componibles, intercambiables y auditables.

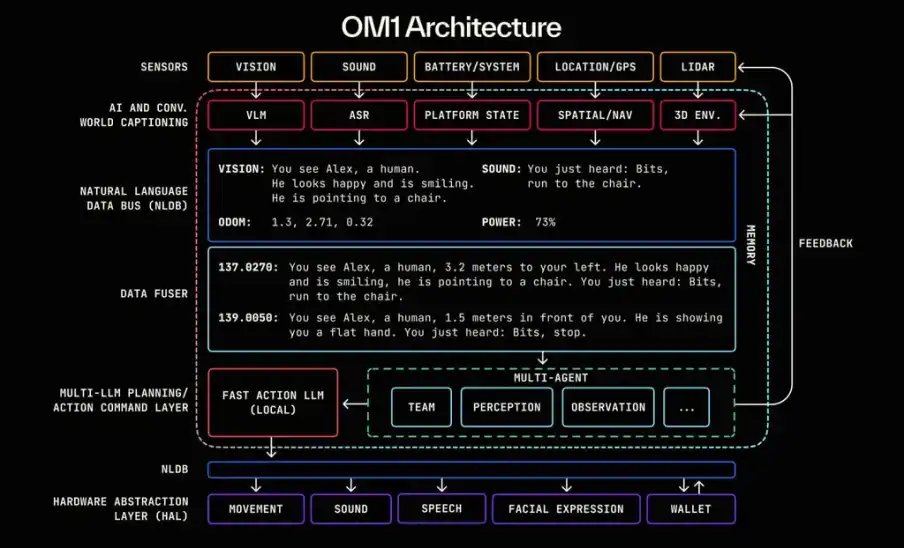

Arquitectura OM1

En detalle, la arquitectura de siete capas de OM1 opera así:

Capa de Sensores: recopila datos (cámaras, LIDAR, micrófonos, batería, GPS y demás entradas multimodales).

Capa IA + Captura del Entorno: interpreta la información; los modelos multimodales traducen datos visuales, sonoros y de estado en descripciones en lenguaje natural (por ejemplo, “Ves a una persona saludando”).

Natural Language Data Bus (NLDB): transmite la información; toda percepción se convierte en fragmentos de lenguaje con marcas temporales y circula entre módulos.

Data Fuser: fusiona la información; agrupa todos los inputs en un contexto completo (prompt) para la toma de decisiones.

Capa de Planificación/Decisión Multi-AI: genera decisiones; varios LLM procesan el contexto y elaboran planes de actuación integrando reglas on-chain.

Canal downstream NLDB: transfiere las decisiones a los sistemas físicos mediante la capa intermedia de lenguaje.

Capa de Abstracción de Hardware: ejecuta acciones; convierte instrucciones en comandos que controlan el hardware (movimiento, comunicaciones, transacciones, etc.).

Implementación Rápida y Extensiva

Para que una “idea” pase a ser una “tarea robotizable” de manera ágil, OM1 ha diseñado un canal de desarrollo inmediato: los desarrolladores pueden definir objetivos y restricciones hablando en lenguaje natural con modelos avanzados, generando paquetes de habilidades reutilizables en cuestión de horas, en lugar de meses de codificación; las pipelines multimodales interconectan LiDAR, voz y visión de forma nativa, evitando la programación de fusión compleja; los modelos preintegrados (GPT-4o, DeepSeek, VLM principales) permiten el uso inmediato de voz; compatibilidad total con ROS2 y Cyclone DDS, integración directa con plataformas como Unitree G1, Go2, Turtlebot y brazos robóticos mediante la Capa de Abstracción de Hardware; conexión nativa con las interfaces de identidad, orquestación de tareas y liquidación on-chain de FABRIC, lo que permite tanto operación autónoma como integración en redes globales con pago por uso y auditoría.

OM1 ya se ha validado en escenarios reales: el cuadrúpedo Frenchie (Unitree Go2) superó tareas complejas en la Exposición USS Hornet Defense Technology 2024; el humanoide Iris (Unitree G1) realizó interacción humano-máquina en el stand de Coinbase en EthDenver 2025 y ha accedido a programas universitarios estadounidenses a través de RoboStore, expandiendo este paradigma a docencia e investigación avanzada.

FABRIC: Red Descentralizada de Colaboración Humano-Máquina

Incluso dotados de gran inteligencia autónoma, si los robots no pueden colaborar bajo confianza verificada permanecen aislados. Dicha fragmentación deriva de tres obstáculos: identidad y localización no estandarizadas ni verificables, por lo que terceros no pueden confiar en “quién soy, dónde estoy y qué hago”; la falta de rutas seguras de autorización para compartir habilidades y datos entre entidades; los derechos de control y responsabilidades son difusos, y los mecanismos de verificación resultan difíciles de acordar o rastrear. FABRIC lo soluciona aplicando protocolos descentralizados para generar identidades verificables on-chain de robots y operadores, ofreciendo infraestructura para publicación y emparejamiento de tareas, comunicación cifrada, registro de ejecuciones y liquidación automática: la colaboración pasa de ser “provisional” a convertirse en “institucional y auditable”.

FABRIC opera como capa de red que aglutina “posicionamiento, conexión y planificación”: la identidad y la ubicación se firman y verifican constantemente, consolidando relaciones transparentes de confianza entre nodos; los canales punto a punto son túneles cifrados bajo demanda, habilitando control y monitorización remotos sin IP pública ni configuraciones de red; la cadena completa, desde la publicación y aceptación de tareas hasta su ejecución y verificación, queda registrada y estandarizada, permitiendo reparto automático de beneficios, devolución de depósitos y verificación de “quién hizo qué, cuándo y dónde” en contextos regulatorios o aseguradores. Ejemplos de aplicación: empresas pueden realizar mantenimiento remoto de equipos, ciudades transformar limpieza, inspección y reparto en Robot-as-a-Service, flotas de vehículos reportar condiciones y obstáculos en tiempo real para crear mapas compartidos, y los robots locales pueden ser enviados para escaneo 3D, levantamientos o recogida de evidencias aseguradoras.

Al centralizar la gestión de identidad, tareas y liquidación en la misma red, los límites colaborativos se establecen de antemano, los hechos se verifican a posteriori y los costes/beneficios de habilidades son medibles. A largo plazo, FABRIC evolucionará hacia una “capa de distribución de aplicaciones” para la inteligencia robótica: las habilidades circularán con autorizaciones programables, los datos de ejecución nutrirán modelos y estrategias, y toda la red colaborativa se auto-mejorará continuamente dentro de parámetros fiables.

Web3: La “Apertura” Como Fundamento de la Sociedad Máquina

La industria robótica se concentra velozmente en unos pocos sistemas, con hardware, algoritmos y redes en arquitecturas cerradas. La descentralización permite que robots de cualquier marca o país colaboren, compartan habilidades y liquiden tareas en una red abierta, sin dependencia de una plataforma única. OpenMind establece este orden mediante infraestructura on-chain: cada robot y operador posee una identidad única (ERC-7777, estándar de identidad), con huellas de hardware y permisos verificables; las tareas se publican, concursan y emparejan bajo reglas abiertas, generando pruebas cifradas on-chain con hora y ubicación; los contratos liquidan automáticamente beneficios, seguros y depósitos tras la tarea, con resultados verificables en tiempo real; las nuevas habilidades fijan recuentos de invocación y dispositivos compatibles mediante contrato, facilitando uso global y protección intelectual. La economía robótica nace, así, antimonopolio, componible y auditable, con la “apertura” codificada en la base de la sociedad máquina.

Facilitando Que la Inteligencia Encarnada Supere el Aislamiento

Los robots están dejando los escenarios de exhibición para instalarse en ámbitos cotidianos: controlan plantas hospitalarias, aprenden nuevas competencias en campus, inspeccionan y modelan en ciudades. El reto clave no está en motores más potentes, sino en que máquinas de distintos orígenes se reconozcan, compartan datos y cooperen; y, más allá de la tecnología, el suministro y la distribución son esenciales para el escalado.

Por ello, OpenMind inicia su estrategia en los canales, no en la acumulación de parámetros. En alianza con RoboStore, uno de los mayores partners de Unitree en EEUU, han hecho de OM1 un estándar curricular y un kit experimental, impulsando el suministro conjunto de hardware y software en miles de universidades estadounidenses. La educación aporta demanda estable, integrando OM1 directamente en el canal de desarrolladores y aplicaciones para los próximos años.

Para ampliar la distribución social, OpenMind aprovecha su ecosistema inversor para crear “canales de exportación software” basados en plataforma. Ecosistemas cripto como Pi refuerzan este modelo, generando un círculo virtuoso de desarrolladores, usuarios y clientes de pago. Con los canales educativos como oferta estable y la escala de plataformas como demanda, OM1 y las aplicaciones superiores pueden expandirse de forma replicable.

En la era Web2, los robots quedaban atrapados en stacks cerrados de proveedores únicos, sin que funciones o datos fluyeran entre plataformas; al unir estándares curriculares y distribución, OpenMind establece la apertura como condición de partida: el mismo sistema llega a campus y empresas, y se difunde en plataformas, haciendo de la apertura el fundamento del despliegue a gran escala.

Aviso Legal:

- Este artículo se ha republicado desde BlockBeats y los derechos de autor corresponden al autor original BlockBeats. Si desea plantear objeciones, contacte con el equipo Gate Learn, que atenderá la solicitud según los procedimientos legales vigentes.

- Advertencia: Las opiniones vertidas en este artículo son exclusivas del autor y en ningún caso constituyen recomendación de inversión.

- Las traducciones de este artículo a otros idiomas son elaboradas por el equipo Gate Learn y no pueden ser copiadas, distribuidas ni reproducidas sin citar expresamente Gate.

Artículos relacionados

¿Qué son las narrativas cripto? Principales narrativas para 2025 (ACTUALIZADO)

¿Qué plataforma construye los mejores agentes de IA? Probamos ChatGPT, Claude, Gemini y más

El Auge de GOAT: La Especulación y Preocupaciones detrás de los Memes de IA | Una Revisión 100x

Protocolo Virtuals: Tokenizando Agentes de IA

Agentes de IA en DeFi: Redefiniendo la Cripto como la Conocemos